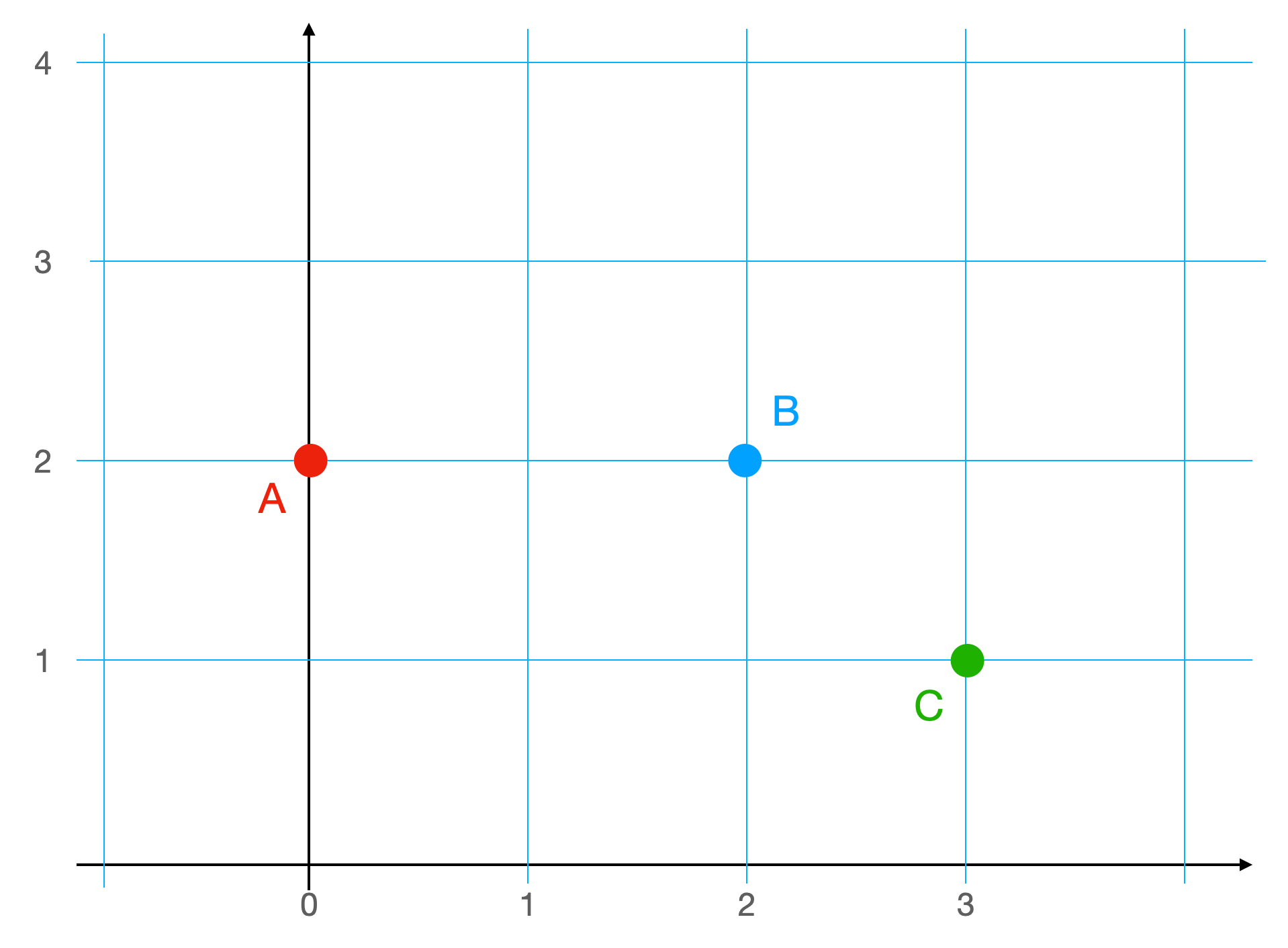

Săptămâna trecută, am avut un examen „la jumătatea perioadei”, pentru cursul nostru de introducere în învățarea statistică. Întrebarea este simplă: luați în considerare trei puncte, ((x_i,y_i)), aici ({(0,2),(2,2),(3,1)})Luați în considerare câteva modele liniare , estimat utilizând tehnicile celor mai mici pătrate, care ar fi MSE de validare încrucișată cu excludere?

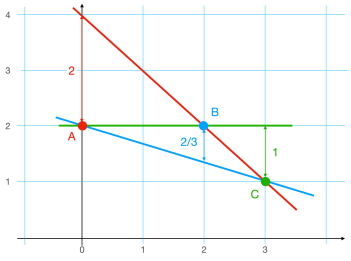

Îmi place acest exercițiu, deoarece putem calcula totul ușor, manual. Deoarece la fiecare pas eliminăm o singură observație, în eșantion rămân doar două observații. Cu două puncte, potrivirea unui model liniar este simplă (indiferent de tehnica luată în considerare). Aici, luăm în considerare pur și simplu linia dreaptă care trece prin celelalte două puncte. Și întrucât avem linia dreaptă (fără calculul minim de minimizare a sumei erorilor pătrate), avem eroarea comisă asupra observației omise. Este exact ceea ce vedem în desenul de mai jos

Cu alte cuvinte, LOOCV MSE este aici({displaystyleoperatorname{MSE}={frac{1}{n}}sum_{i=1}^{n}left(Y_{i}-{ hat {Y_{i}}^{(-i)}}right)^{2}}), unde, intuitiv, (hat {Y_{i}}^{(-i)}) denotă predicția asociată cu (x_i) cu modelul obținut pe celelalte observații (n-1). Astfel, aici({displaystyleoperatorname{MSE}=frac{1}{3}big(2^2+frac{2^2}{3^2}+1^2big)= frac{1}{27}big(36+4+9big)=frac{49}{27}})Rețineți că putem folosi și R pentru a calcula acea cantitate,

> x = c(0,2,3)

> y = c(2,2,1)

> df = data.frame(x=x,y=y)

> yp = rep(NA,3)

> for(i in 1:3){

+ reg = lm(y~x, data=df(-i,))

+ yp(i) = predict(reg,newdata=df)(i)

+ }

> 1/3*sum((yp-y)^2)

(1) 1.814815

care este exact ceea ce am obținut, manual.