Când cineva vede ceva care nu este acolo, oamenii se referă adesea la experiență ca halucinație. Halucinațiile apar atunci când percepția dvs. senzorială nu corespunde stimulilor externi. Tehnologiile care se bazează pe inteligența artificială pot avea și halucinații.

Când un sistem algoritmic generează informații care par plauzibil Dar este de fapt inexact sau înșelător, informaticienii o numesc o halucinație AI.

Nota editorului:

Autorii invitați Anna Choi și Katelyn Xiaoying MEI sunt studenți de doctorat în știința informației. Lucrarea Anei se referă la intersecția dintre etica AI și recunoașterea vorbirii. Lucrările de cercetare ale lui Katelyn se referă la psihologie și interacțiune umană-AI. Acest articol este republicat din conversație sub o licență Creative Commons.

Cercetătorii și utilizatorii au găsit aceste comportamente în diferite tipuri de sisteme AI, de la chatbots, cum ar fi chatgpt până la generatoare de imagini, cum ar fi Dall-E până la vehicule autonome. Suntem cercetători în știința informației care au studiat halucinații în sistemele de recunoaștere a vorbirii AI.

Oriunde sistemele AI sunt utilizate în viața de zi cu zi, halucinațiile lor pot prezenta riscuri. Unele pot fi minore-atunci când un chatbot oferă un răspuns greșit la o întrebare simplă, utilizatorul poate ajunge la informat.

Dar în alte cazuri, mizele sunt mult mai mari.

În această etapă timpurie a dezvoltării AI, problema nu este doar cu răspunsurile mașinii – este și cu modul în care oamenii tind să le accepte ca fiind factual, pur și simplu pentru că sună credibili și plauzibili, chiar și atunci când nu sunt.

Am văzut deja cazuri în sălile de judecată, în care software-ul AI este utilizat pentru a lua decizii de condamnare către companiile de asigurări de sănătate care utilizează algoritmi pentru a determina eligibilitatea unui pacient pentru acoperire, halucinațiile AI pot avea consecințe care modifică viața. Ele pot chiar pune viața în pericol: vehiculele autonome folosesc AI pentru a detecta obstacole: alte vehicule și pietoni.

Făcând -o

Halucinațiile și efectele lor depind de tipul de sistem AI. Cu modele mari de limbaj, halucinațiile sunt informații care sună convingătoare, dar sunt incorecte, alcătuite sau irelevante.

Un chatbot ar putea crea o referință la un articol științific care nu există sau să ofere un fapt istoric care este pur și simplu greșit, totuși îl face să pară credibil.

Într -un caz de judecată din 2023, de exemplu, un avocat din New York a depus un brief legal pe care l -a scris cu ajutorul Chatgpt. Un judecător discernant a observat mai târziu că sumarul a citat un caz pe care ChatGPT l -a alcătuit. Acest lucru ar putea duce la rezultate diferite în sălile de judecată dacă oamenii nu ar fi capabili să detecteze informațiile halucinate.

Cu instrumente AI care pot recunoaște obiecte în imagini, halucinațiile apar atunci când AI generează subtitrări care nu sunt credincioase imaginii furnizate.

Imaginați -vă că cereți unui sistem să enumere obiecte într -o imagine care include doar o femeie de la piept, vorbind pe un telefon și primind un răspuns care spune o femeie care vorbește pe un telefon în timp ce stă pe o bancă. Această informație inexactă ar putea duce la consecințe diferite în contextele în care precizia este critică.

Ce provoacă halucinații

Inginerii construiesc sisteme AI prin colectarea unor cantități masive de date și alimentării lor într -un sistem de calcul care detectează modele în date. Sistemul dezvoltă metode pentru a răspunde la întrebări sau îndeplinirea sarcinilor pe baza acestor modele.

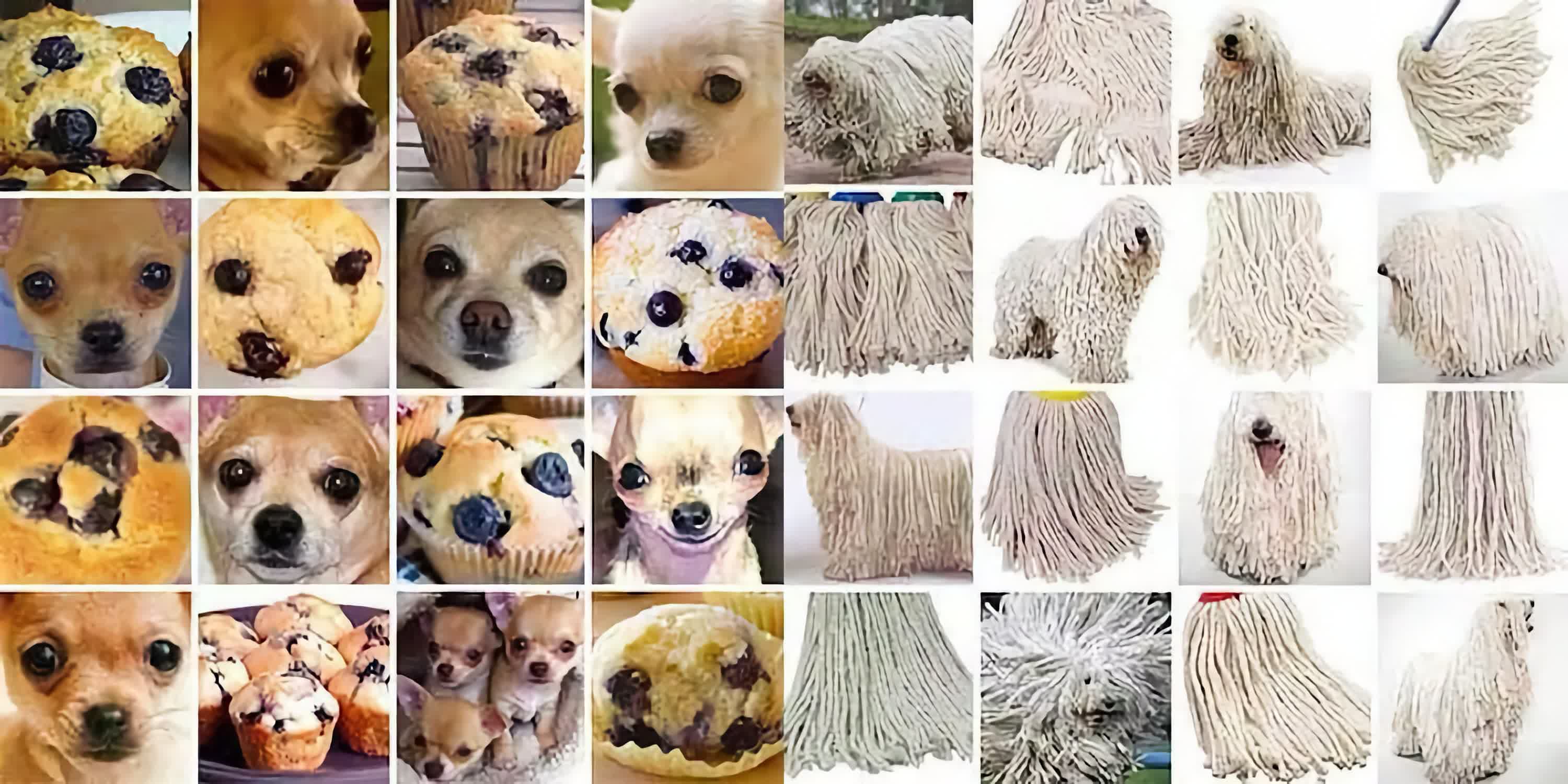

Furnizați un sistem AI cu 1.000 de fotografii cu diferite rase de câini, etichetați în consecință, iar sistemul va învăța în curând să detecteze diferența dintre un poodle și un retriever de aur. Dar hrănește -i o fotografie cu o brioșă de afine și, așa cum au arătat cercetătorii de învățare automată, vă poate spune că brioșa este un Chihuahua.

Atunci când un sistem nu înțelege întrebarea sau informațiile cu care este prezentată, acesta poate halucina. Halucinațiile apar adesea atunci când modelul completează lacunele bazate pe contexte similare din datele sale de instruire sau când este construit folosind date de instruire părtinitoare sau incomplete. Acest lucru duce la ghiciri incorecte, ca în cazul brioșei de afine greșite.

Este important să distingem între halucinațiile AI și ieșirile AI creative intenționat. Când un sistem AI este solicitat să fie creativ – ca atunci când scrie o poveste sau generează imagini artistice – rezultatele sale noi sunt așteptate și dorite.

Halucinațiile, pe de altă parte, apar atunci când un sistem AI este solicitat să furnizeze informații factuale sau să îndeplinească sarcini specifice, dar în schimb generează conținut incorect sau înșelător, în timp ce îl prezintă ca fiind exact.

Diferența cheie constă în context și scop: creativitatea este adecvată pentru sarcinile artistice, în timp ce halucinațiile sunt problematice atunci când sunt necesare precizia și fiabilitatea. Pentru a aborda aceste probleme, companiile au sugerat să utilizeze date de instruire de înaltă calitate și limitarea răspunsurilor AI pentru a urma anumite orientări. Cu toate acestea, aceste probleme pot persista în instrumente populare AI.

Ce este în pericol

Impactul unei producții, cum ar fi apelarea unei brioșe de afine, un Chihuahua poate părea banală, dar ia în considerare diferitele tipuri de tehnologii care utilizează sisteme de recunoaștere a imaginilor: un vehicul autonom care nu reușește să identifice obiectele ar putea duce la un accident de trafic fatal. O dronă militară autonomă care identifică greșit o țintă ar putea pune viața civililor în pericol.

Pentru instrumentele AI care oferă recunoaștere automată a vorbirii, halucinațiile sunt transcrieri AI care includ cuvinte sau fraze care nu au fost niciodată rostite de fapt. Acest lucru este mai probabil să apară în medii zgomotoase, în care un sistem AI poate ajunge să adauge cuvinte noi sau irelevante, în încercarea de a descifra zgomotul de fundal, cum ar fi un camion care trece sau un copil care plânge.

Pe măsură ce aceste sisteme devin mai integrate în mod regulat în asistența medicală, serviciile sociale și setările juridice, halucinațiile în recunoașterea automată a vorbirii ar putea duce la rezultate clinice sau legale inexacte, care dăunează pacienților, inculpaților criminali sau familiilor care au nevoie de sprijin social.

Verificați munca AI – nu aveți încredere – verificați AI

Indiferent de eforturile companiilor AI de a atenua halucinațiile, utilizatorii ar trebui să rămână vigilenți și să pună la îndoială rezultatele AI, mai ales atunci când sunt utilizate în contexte care necesită precizie și precizie.

Verificarea dublă a informațiilor generate de AI cu surse de încredere, experți în consultanță atunci când este necesar și recunoașterea limitărilor acestor instrumente sunt pași esențiali pentru minimizarea riscurilor lor.

Dacă vă bucurați de conținutul nostru, vă rugăm să luați în considerare abonarea.

- Experiență Techspot fără anunțuri în timp ce ne sprijinim munca

- Promisiunea noastră: Toate contribuțiile cititorilor se vor îndrepta către finanțarea mai mult conținut

- Asta înseamnă: Mai multe caracteristici tehnologice, mai multe repere și analize