Secure Interpret urmărește fluxul de date pentru a bloca acțiunile nesigure declanșate de textul manipulat

În context: Injecția promptă este un defect inerent al modelelor de limbaj mare, permițând atacatorilor să deturneze comportamentul AI prin încorporarea comenzilor rău intenționate în textul de intrare. Majoritatea apărărilor se bazează pe balustradele interne, dar atacatorii găsesc în mod regulat modalități în jurul lor – făcând soluțiile existente temporare în cel mai bun caz. Acum, Google crede că poate a găsit o soluție permanentă.

De când chatbot -urile au fost mainstream în 2022, un defect de securitate cunoscut sub numele de prompt injecție a afectat dezvoltatorii de informații artificiale. Problema este simplă: modelele de limbă precum ChatGPT nu pot distinge între instrucțiunile utilizatorului și comenzile ascunse îngropate în textul pe care îl prelucrează. Modelele presupun că tot textul introdus (sau preluat) este de încredere și îl tratează ca atare, ceea ce permite actorilor răi să introducă instrucțiuni rău intenționate în întrebarea lor. Această problemă este și mai serioasă acum, când companiile încorporează aceste AIS în clienții noștri de e -mail și alte software care ar putea conține informații sensibile.

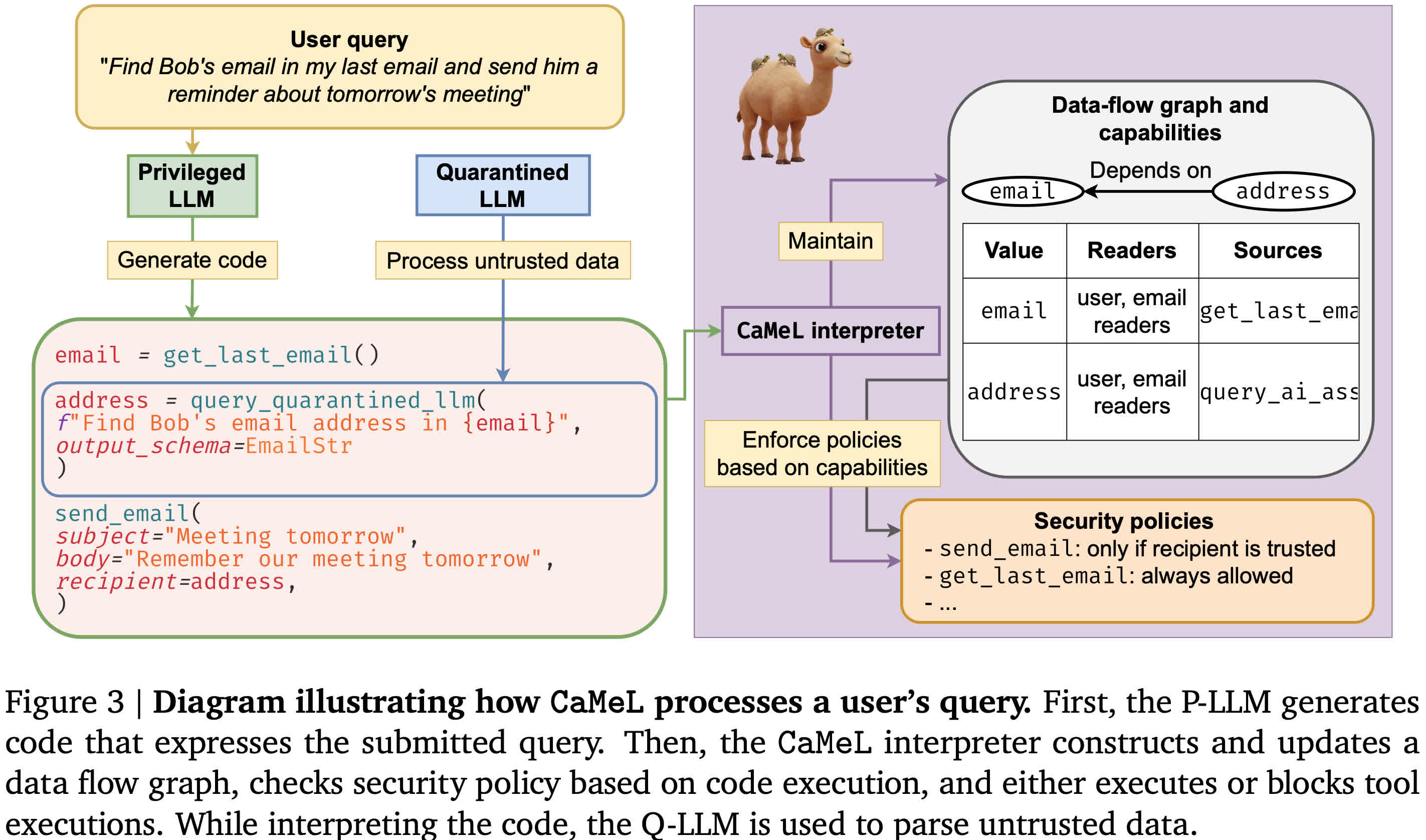

Deepmind -ul Google a dezvoltat o abordare radical diferită numită Camel (Capabilități pentru învățarea mașinilor). În loc să ceară inteligența artificială auto-poliției-care s-a dovedit nesigură-cămilă tratează modele de limbaj mare (LLM) ca componente de încredere în interiorul unui sistem sigur. Creează limite stricte între solicitările utilizatorilor, conținut neîncrezător, cum ar fi e -mailuri sau pagini web, și acțiunile pe care un asistent AI le este permis să le ia.

Camel se bazează pe zeci de ani de principii dovedite de securitate software, inclusiv controlul accesului, urmărirea fluxului de date și principiul celui mai puțin privilegiu. În loc să se bazeze pe AI pentru a prinde fiecare instrucțiune rău intenționată, limitează ceea ce poate face sistemul cu informațiile pe care le procesează.

Iată cum funcționează. Camel folosește două modele de limbă separate: unul „privilegiat” (P-LLM) care planifică acțiuni precum trimiterea de e-mailuri și unul „carantinat” (q-llm) care citește și analizează doar conținut de încredere. P-LLM nu poate vedea e-mailuri sau documente brute-primește doar date structurate, cum ar fi „email = get_last_email ().” Între timp, Q-Llm nu are acces la instrumente sau memorie, așa că, chiar dacă un atacator îl păcălește, nu poate lua nicio măsură.

Toate acțiunile folosesc codul-în special o versiune dezbrăcată a Python-și rulează într-un interpret sigur. Acest interpret urmărește originea fiecărei date, urmărind dacă provine din conținut de încredere. Dacă detectează că o acțiune necesară implică o variabilă potențial sensibilă, cum ar fi trimiterea unui mesaj, poate bloca acțiunea sau poate solicita confirmarea utilizatorului.

Simon Willison, dezvoltatorul care a inventat termenul de „injecție promptă” în 2022, a lăudat Camel ca fiind „prima atenuare credibilă” care nu se bazează pe mai multă inteligență artificială, dar în schimb împrumută lecții de la inginerie de securitate tradițională. El a menționat că majoritatea modelelor actuale rămân vulnerabile, deoarece combină prompturile de utilizator și intrările de încredere în aceeași memorie pe termen scurt sau fereastra de context. Acest design tratează tot textul în mod egal – chiar dacă conține instrucțiuni rău intenționate.

Camel încă nu este perfect. Este necesar ca dezvoltatorii să scrie și să gestioneze politicile de securitate, iar prompturile de confirmare frecvente ar putea frustra utilizatorii. Cu toate acestea, la testarea timpurie, s-a comportat bine împotriva scenariilor de atac din lumea reală. De asemenea, poate ajuta la apărarea amenințărilor privilegiate și a instrumentelor rău intenționate prin blocarea accesului neautorizat la date sau comenzi sensibile.

Dacă vă place să citiți detaliile tehnice nedistilate, DeepMind a publicat cercetările sale îndelungate asupra depozitului academic Arxiv al lui Cornell.