De asemenea, Dell lansează primul PC din lume cu accelerator discret Qualcomm AI

Imaginea de ansamblu: În cadrul evenimentului Dell Technologies World din acest an, compania a anunțat noi produse care includ cipuri de accelerație AI de la AMD, Intel, Nvidia și Qualcomm pe linii sale de server și PC. Având în vedere că cipurile AI oferă acum unele dintre cele mai largi opțiuni de pe piața semiconductorilor, mișcarea are sens. Totuși, este o gamă impresionantă de oferte care evidențiază cât de rapid a evoluat ecosistemul hardware AI în ultimii ani.

Alegerea este un lucru frumos. Acest lucru este valabil mai ales pentru companiile care construiesc produse pentru a răspunde nevoilor diverse ale unei game largi de clienți. Așadar, nu este de mirare să vezi că Dell Technologies îmbrățișează această mentalitate în cele mai recente oferte hardware, dezvăluite la evenimentul mondial Dell Technologies.

Ceea ce este remarcabil și despre abordarea Dell este faptul că reflectă impulsul din ce în ce mai mare și creșterea sofisticatului produselor care intră pe piețele serverului și al PC -ului.

După ani de stagnare, serverele de întreprindere se bucură de o reînviere în interes.

După ani de stagnare, serverele de întreprindere se bucură de o reînviere în interes. Companiile recunosc valoarea de a-și conduce propriile sarcini de muncă AI și de a construi centre de date capabile AI. Drept urmare, furnizorii tradiționali de server precum Dell – și concurenții săi – văd o cerere reînnoită.

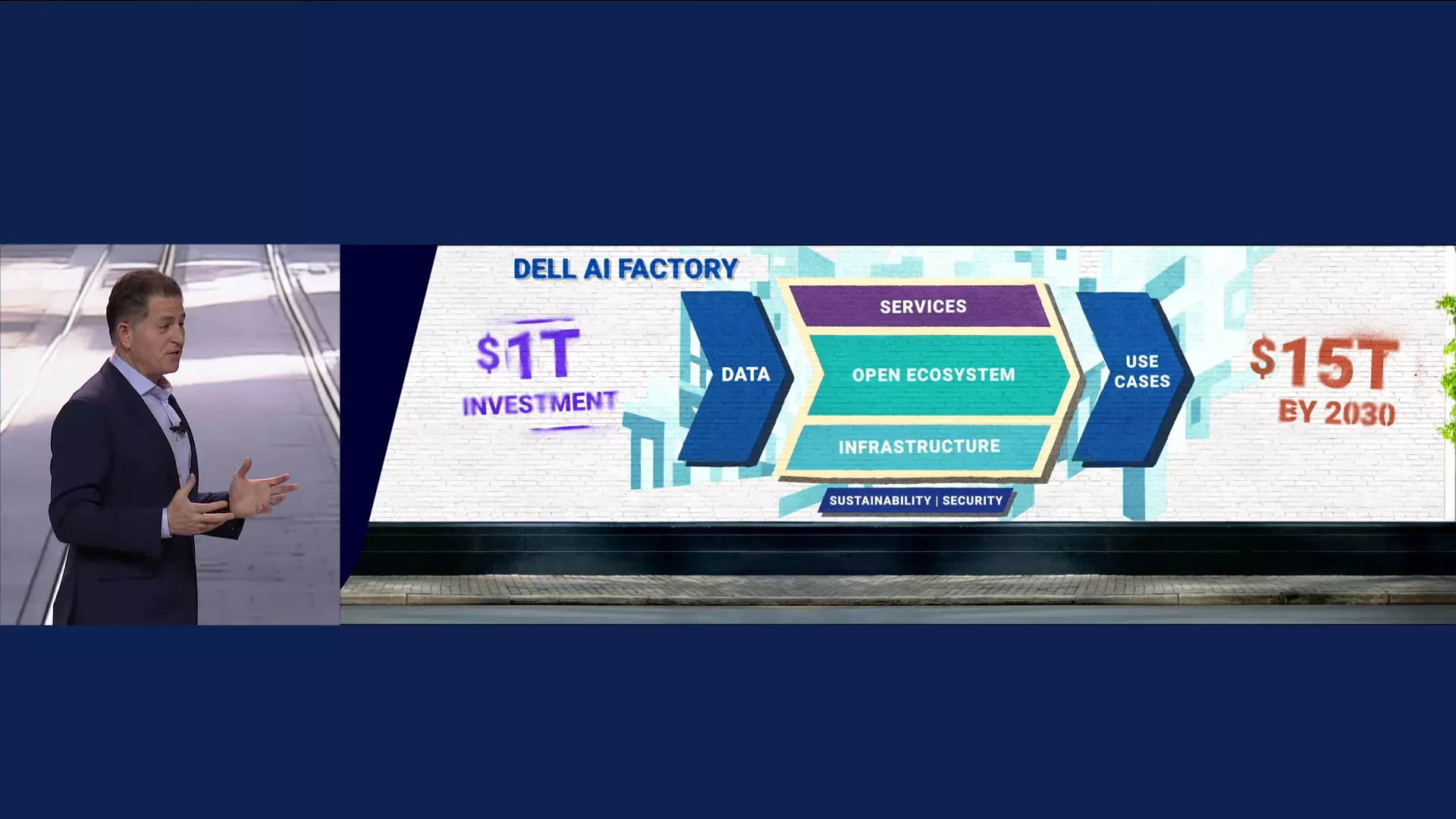

Apăsarea Nvidia pentru fabricile AI Enterprise a jucat, de asemenea, un rol. În creditul lui Dell, a fost de fapt primul care a introdus conceptul prin colaborarea proiectului Helix cu Nvidia acum doi ani. De atunci, NVIDIA s -a aplecat în această tendință, dezvoltând atât stive hardware, cât și software optimizate pentru sarcini de lucru pentru întreprinderi AI.

Motivele care stau la baza acestui fapt sunt destul de simple. Potrivit mai multor surse, majoritatea companiilor încă adăpostesc majoritatea datelor lor din spatele firewall -urilor corporative. Mai important, datele care nu au fost mutate în cloud sunt adesea cele mai sensibile și valoroase-exact genul care este cel mai eficient pentru antrenament și reglare fină a modelelor AI. Acest lucru face logic să se proceseze sarcinile de lucru AI la nivel local. Este un caz clasic de gravitație a datelor: companiile doresc să conducă sarcini de lucru unde se află datele.

Asta nu înseamnă că întreprinderile trag înapoi din cloud. În schimb, există o recunoaștere din ce în ce mai mare pe care Cloud și On-Premiss Computing poate coexista. De fapt, datorită standardelor emergente precum Protocolul de context al modelului (MCP), aplicațiile Hybrid AI distribuite care utilizează atât nori publici cât și privați se vor muta probabil la mainstream într -o manieră foarte rapidă.

Având în vedere acest context, nu este de mirare că Dell își extinde ofertele comune de fabrică AI cu Nvidia. Compania introduce noi configurații ale serverelor sale PowerEdge XE9780 și XE9785 cu cipuri Blackwell Ultra Blackwell de la Nvidia-disponibile atât în modele răcite cu aer, cât și în designuri răcite cu lichid. Dell este, de asemenea, printre primii care susține noua arhitectură RTX Pro a NVIDIA, introdusă la Computex din Taiwan.

Noul server Dell PowerEdge XE7745 combină procesoare X86 tradiționale, împreună cu GPU-urile RTX Pro 6000 Blackwell Server RTX Pro 6000 Blackwell de la un design răcit cu aer, ceea ce face semnificativ mai ușor pentru multe întreprinderi să își modernizeze centrele de date existente. Ideea este că aceste noi servere pot rula sarcini de lucru tradiționale ale serverului, deschizând, de asemenea, opțiunea pentru a rula anumite sarcini de lucru AI. Aceste sisteme nu au puterea de procesare de ultimă generație a celor mai avansate sisteme Blackwell concepute pentru medii bazate pe cloud, dar au mai mult decât suficient pentru a gestiona multe dintre sarcinile de muncă AI pe care întreprinderile vor dori să le funcționeze în propriile lor medii.

Dincolo de opțiunile bazate pe Nvidia, Dell a introdus, de asemenea, o serie de servere PowerEdge XE9785 folosind GPU-urile AMD Instinct MI350. Datorită unei stive de software ROCM actualizate, aceste sisteme sunt considerate o alternativă viabilă-și, în unele cazuri, mai eficientă în putere-alternativă la configurațiile bazate pe NVIDIA. Mai important, acestea oferă întreprinderilor o flexibilitate mai mare în selecția vânzătorilor.

În mod similar, Dell a anunțat una dintre primele implementări ale acceleratoarelor AI Gaudi 3 de la Intel Gaudi 3, folosind servere PowerEdge XE9680 configurate cu opt cipuri Gaudi 3. Aceste soluții oferă o alternativă mai rentabilă și sunt deosebit de potrivite pentru organizațiile care utilizează stiva software AI Intel și modele optimizate de pe platforme precum îmbrățișarea Face.

Unul dintre cele mai intrigante anunțuri a venit din divizia PC -ului Dell: lansarea Dell Pro Max Plus Portable Station. Aceasta marchează prima utilizare a unui NPU discret într -un computer mobil – în special, Qualcomm A100.

Utilizând interfața utilizată de obicei pentru GPU -uri discrete, Dell a fost capabil să aducă acest nou accelerator într -un design existent. Cardul de inferență A100 PC dispune de două jetoane discrete cu un total de 32 de nuclee de accelerație AI și 64 GB de memorie dedicată. Compania vizează dispozitivul de la organizații care doresc să ruleze aplicații de inferență personalizate la margine, precum și pentru dezvoltatorii de modele AI care doresc să utilizeze designul NPU Qualcomm (deși este important să rețineți că este o arhitectură NPU diferită decât se găsește în seria Snapdragon X de SOC-uri bazate pe brațe).

Viitorul AI este la margine – de la dezvoltarea de noi tratamente pentru cancer la creșterea unei afaceri, informațiile de date în timp real vor fi în centrul progreselor umane.

Urmăriți @Michaeldell’s #DellTechWorld Adresa Keynote: https://t.co/ljy1oxoolu #delltechworld pic.twitter.com/wvxmvo4zlj

– Dell Technologies (@DellTech) 19 mai 2025

Datorită cache -ului său mare de memorie de la bord, A100 permite utilizarea modelelor cu peste 100 de miliarde de parametri – depășind cu mult ceea ce este posibil chiar și pe cele mai avansate PC -uri Copilot+ astăzi.

În plus față de hardware, Dell a anunțat mai multe capabilități software noi pentru platformele sale de server AI Factory sub umbrela platformei de date Dell AI. Una dintre cele mai mari provocări cu modele mari de AI este accesul rapid la date și încărcarea memoriei. Noul proiect al lui Dell se adresează acestui lucru cu un sistem de fișiere paralel pe care compania susține că o oferă de două ori performanța oricărei soluții comparabile. De asemenea, Dell și -a îmbunătățit Data Lakehouse, o structură folosită de multe aplicații AI pentru a accesa și gestiona seturi de date mari mai eficient.

Cu toate acestea, Dell a reunit ceea ce pare a fi un set solid de noi oferte axate pe AI, care oferă întreprinderilor o gamă largă de alternative din care să aleagă. Având în vedere creșterea rapidă a aplicațiilor AI, așa cum s -a evidențiat în timpul notei cheie de deschidere a evenimentului, se pare că combinația de opțiuni diferite pe care Dell le aduce pe piață ar trebui să permită chiar și cele mai specifice cerințe de la o anumită întreprindere care trebuie îndeplinită într -o manieră foarte vizată.

Bob O’Donnell este fondatorul și analistul șef al Technisy Research, LLC O firmă de consultanță tehnologică care oferă servicii de consultanță strategică și cercetare de piață industriei tehnologice și comunității financiare profesionale. Îl poți urma pe x @bobodtech