Noul Trillium TPU promite o creștere de patru ori a vitezei de antrenament și de trei ori a inferenței

Pe scurt: Prin integrarea hardware personalizat, cum ar fi Trillium, cu GPU-uri lidere din industrie de la Nvidia, Google Cloud se poziționează ca competitor în domeniul în evoluție rapidă al calculului AI. Cele mai recente progrese ale sale promit să accelereze dezvoltarea și implementarea modelelor și aplicațiilor AI sofisticate în diverse industrii.

Google Cloud a anunțat recent o actualizare majoră a infrastructurii sale de inteligență artificială, introducând noi soluții hardware și software concepute pentru a răspunde cerințelor tot mai mari ale sarcinilor de lucru ale inteligenței artificiale. Piesa centrală a acestor schimbări este lansarea Trillium, a șasea generație a Tensor Processing Unit (TPU) de la Google.

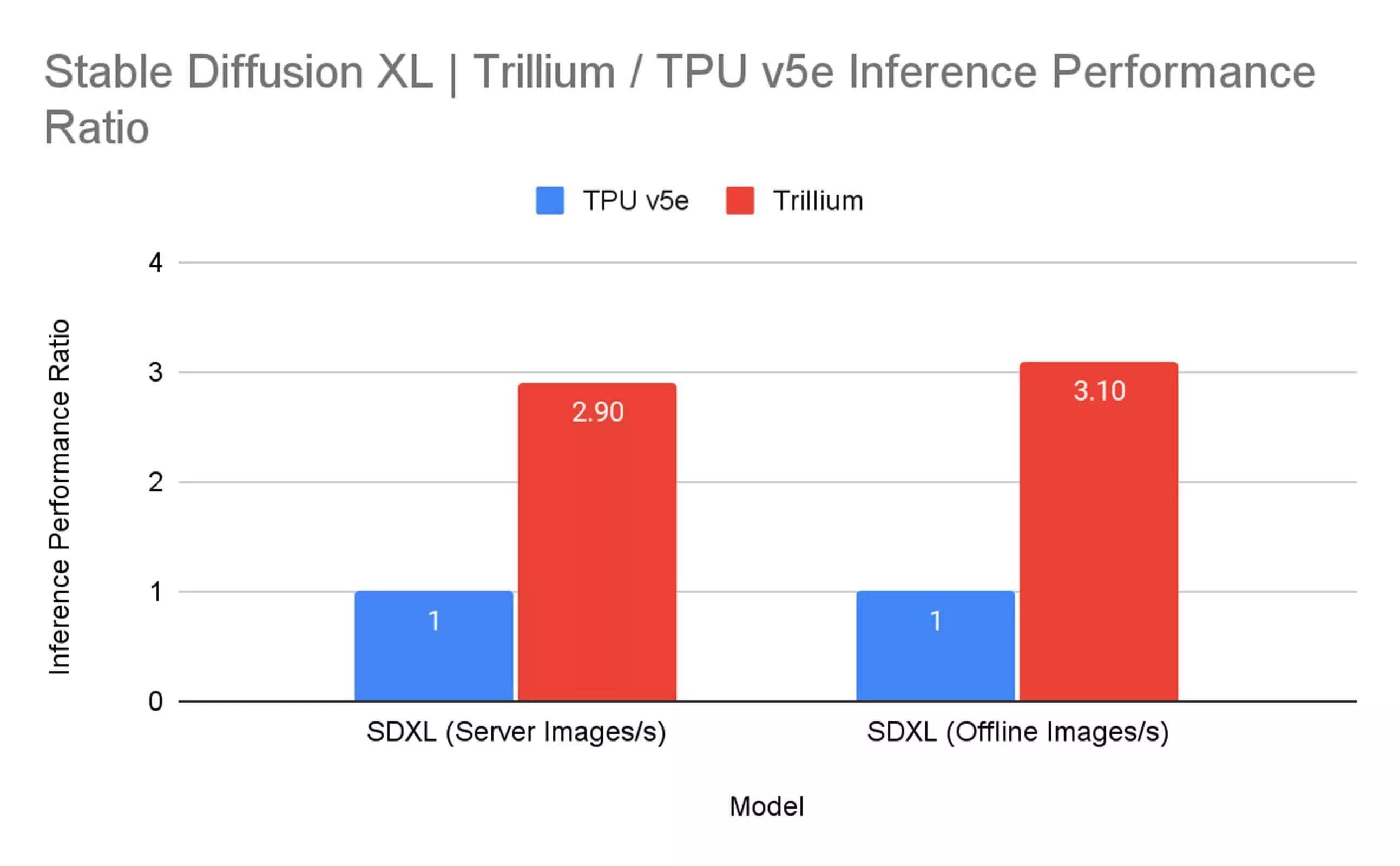

În comparație cu predecesorul său, TPU v5e, Trillium oferă o performanță de antrenament de peste patru ori mai mare și de până la trei ori mai mare decât debitul de inferență. Această îmbunătățire este însoțită de o creștere cu 67% a eficienței energetice.

Noul TPU se mândrește cu specificații impresionante, inclusiv capacitatea dublă a memoriei cu lățime de bandă mare (HBM) și lățime de bandă Interchip Interconnect (ICI), ceea ce face Trillium deosebit de potrivit pentru manipularea modelelor de limbaj mari, cum ar fi Gemma 2 și Llama, precum și pentru sarcini de inferență intensive în calcul. precum cele cerute de modelele de difuzie precum Stable Diffusion XL.

O caracteristică remarcabilă a Trillium este scalabilitatea sa. Un singur pod cu lățime de bandă mare și cu latență redusă poate încorpora până la 256 de cipuri Trillium, iar această configurație poate fi scalată la sute de poduri, creând efectiv un supercomputer la scară clădire interconectat de rețeaua de centre de date Jupiter de la Google, care oferă o capacitate de 13 petabiți pe secundă. Software-ul Multislice de la Trillium permite scalarea performanței aproape liniară în aceste clustere vaste.

Testele de referință ale Google înseamnă să prezinte capacitățile Trillium. În comparație cu TPU v5e, performanța de antrenament pentru modele precum Gemma 2-27b, MaxText Default-32b și Llama2-70B a crescut de peste patru ori. Pentru sarcinile de inferență, Trillium a obținut o creștere de trei ori a debitului atunci când rulează Stable Diffusion XL.

Odată cu lansarea Trillium, Google Cloud a anunțat planuri de a introduce A3 Ultra Virtual Machines (VM) alimentate de GPU-urile Nvidia H200 Tensor Core. Programate pentru previzualizare luna viitoare, aceste noi VM-uri promit să livreze de două ori mai mult decât lățimea de bandă de rețea GPU-la-GPU față de predecesorii lor, A3 Mega VM.

Mașinile virtuale A3 Ultra sunt concepute pentru a oferi performanță de până la dublarea sarcinilor de inferență LLM, datorită capacității de memorie de aproape două ori și lățimii de bandă a memoriei de 1,4 ori mai mari decât A3 Mega VM. Aceste mașini virtuale vor fi disponibile și prin Google Kubernetes Engine.

Google Cloud lansează, de asemenea, Hypercompute Cluster, un sistem de clustering extrem de scalabil, menit să simplifice implementarea și gestionarea infrastructurii AI la scară largă. Acest sistem permite clienților să trateze mii de acceleratoare ca o singură unitate unificată.