Cu toate acestea, sunt foarte buni să convingă oamenii cu privire la validitatea rezultatelor lor ciudate

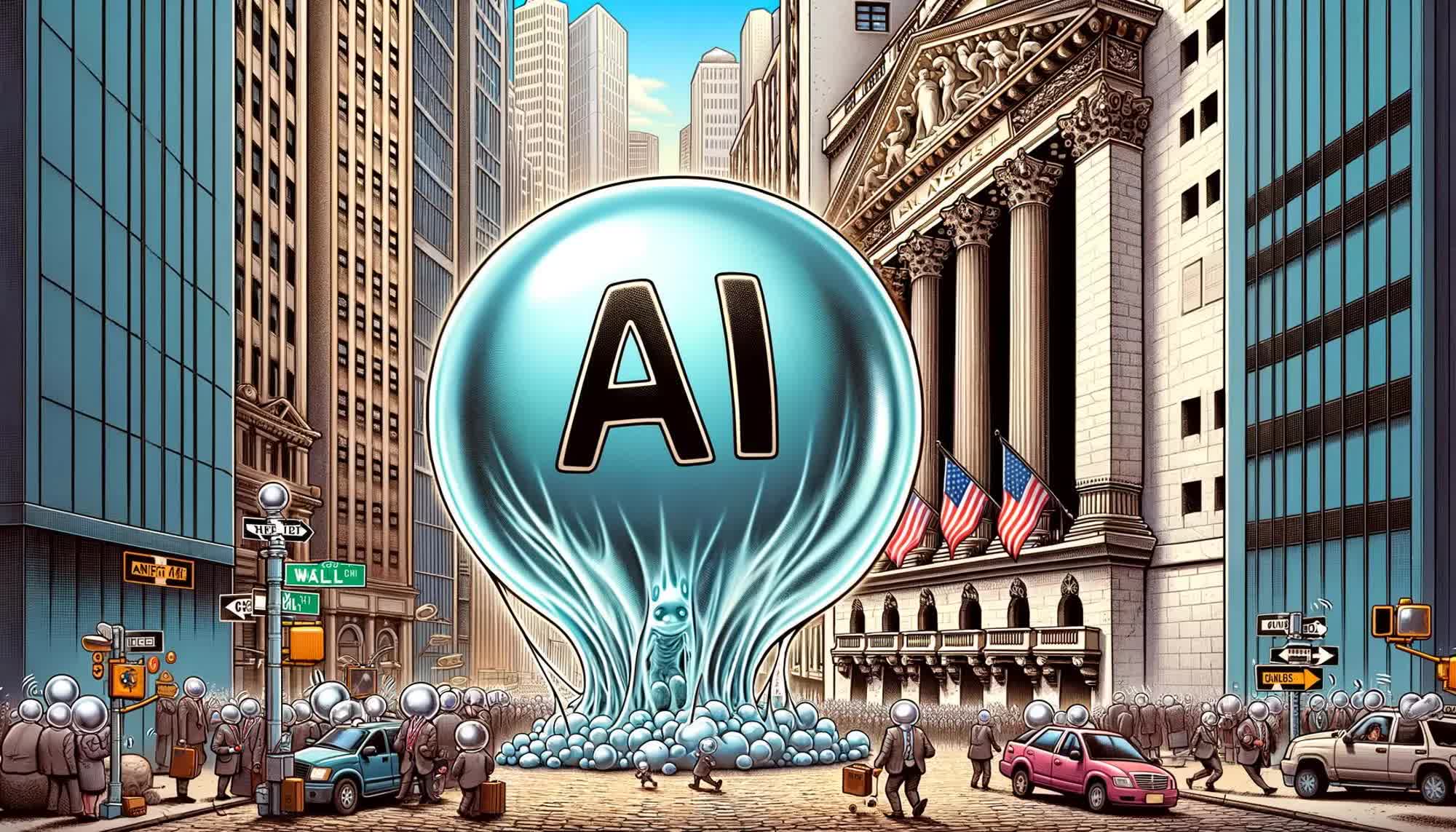

Bulls**t Automation: Serviciile AI generative gâdilă imaginația fiecărui CEO din industria tehnologiei chiar acum. Se așteaptă ca aceștia să înlocuiască milioane de muncitori și să automatizeze aproape totul, dar cercetătorii MIT avertizează că modelele AI nu înțeleg cu adevărat „regulile” sistemelor complexe.

Se presupune că un model de limbaj mare (LLM) poate imita inteligența umană și poate oferi rezultate foarte convingătoare bazate pe solicitarea textuală a utilizatorului. Cu toate acestea, modelul prezice pur și simplu, uneori cu o precizie nemaipomenită, cele mai bune cuvinte de pus alături de cele anterioare într-un context textual specific. Când LLM-urile se confruntă cu condiții imprevizibile, din lumea reală, producția lor poate deveni rapid nesigură.

Cercetătorii MIT au încercat să dezvolte noi valori pentru a verifica în mod corespunzător dacă sistemele AI generative pot înțelege lumea, cum ar fi verificarea capacității lor de a oferi indicații pas cu pas în New York City. LLM-urile moderne par să învețe „implicit” modele de lume, au spus cercetătorii într-un studiu recent, dar trebuie să existe o modalitate oficializată de a evalua corect această vitrină aparent remarcabilă a „inteligenței”.

Echipa sa concentrat pe transformatoare, un tip de model AI generativ folosit de servicii populare precum GPT-4. Transformers sunt instruiți pe baze de date masive de date bazate pe limbaj, astfel încât devin foarte pricepuți în faptele lor de predicție a textului. Cercetătorii au evaluat apoi predicțiile AI generative utilizând o clasă de probleme cunoscută sub numele de automat determinist finit (DFA).

Definiția DFA include diferite tipuri de probleme, cum ar fi raționamentul logic, navigarea geografică, chimia sau jocul. Oamenii de știință de la MIT au ales două probleme diferite – conducerea pe străzile din New York și jocul Othello – pentru a testa capacitatea AI de a înțelege corect regulile de bază. „Aveam nevoie de bancuri de testare în care să știm care este modelul mondial. Acum, ne putem gândi cu rigurozitate la ce înseamnă recuperarea acestui model mondial”, a spus cercetătorul postdoctoral de la Harvard Keyon Vafa.

Transformatoarele testate au fost în general capabile să genereze direcții precise și mișcări Othello valide, dar au funcționat slab atunci când cercetătorii au adăugat ocoliri pe harta New York. În acest caz particular, toate modelele AI generative nu au putut „citi” în mod corespunzător ocolirile, propunând treceri aleatorii care nu existau de fapt sau străzi cu orientări „imposibile”.

Performanța AI generativă s-a deteriorat rapid după ce a adăugat un singur ocol, a declarat Vafa. După închiderea a doar 1% din posibilele străzi de pe hartă, precizia modelului a trecut de la aproape 100% la doar 67%. Rezultatele studiului arată că LLM-urile bazate pe transformatoare pot fi precise în anumite sarcini, dar nu înțeleg și nu captează modele exacte ale lumii. Sau, așa cum a spus faimosul informatician Alan Blackwell, doar automatizăm tauri**t din nou și din nou.