La Appsilon, integrăm modele mari de limbaj în strălucire pentru aplicațiile Python de ceva vreme. Un lucru a devenit clar: provocarea nu este în integrarea inițială. Shiny pentru componenta UI.Chat a lui Python face acest lucru simplu. Complexitatea reală constă în construirea de aplicații care pot evolua cu nevoile dvs.

Python întâlnește Shiny: Ce poți construi? Aflați în ghidul nostru final, plin de informații și sfaturi practice.

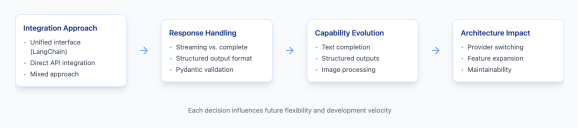

Am văzut că proiectele încep cu o simplă completare a textului, să crească pentru a include ieșiri structurate și, în cele din urmă, gestionăm procesarea imaginilor. Fiecare iterație a adus noi decizii tehnice: utilizați o interfață LLM unificată precum Langchain sau lucrați direct cu API -urile OpenAI și Claude? Răspunsuri de streaming sau non-streaming?

Acest post împărtășește idei arhitecturale cheie din călătoria noastră. Veți învăța cum să vă structurați proiectul pentru a face iterațiile viitoare posibile și eficiente. Ne vom concentra pe deciziile practice care au un impact asupra mentenabilității și flexibilității, extragerea din experiența noastră de aplicații de producție de construcții.

Hai să ne scufundăm!

Alegeri arhitecturale inteligente

Cheia pentru menținerea vitezei în proiectele LLM este separarea îngrijorărilor. UI-ul dvs. de chat nu ar trebui să știe dacă utilizați GPT-4O, Claude sau un model local.

Iată ce funcționează pentru noi:

- Logica furnizorului LLM separat -Creați o clasă dedicată LLM Handler care încapsulează tot codul specific furnizorului. Am învățat acest lucru pe calea grea – când a trebuit să trecem de la Langchain la OpenAI Raw pentru procesarea imaginilor, având cod de furnizor strâns cuplat însemna să atingem mai multe părți ale aplicației. O separare curată face ca aceste tranziții să fie gestionabile.

- Activați testarea fără API -uri – Creați o clasă Mock LLM Handler care implementează aceeași interfață ca și adevăratul dvs. manipulator. Acest lucru vă permite să testați comportamentul UI al aplicației dvs. fără a efectua apeluri scumpe API. Dacă aplicația dvs. folosește răspunsuri la streaming, batjocorește și acestea – este crucial să te testezi aplicația în aceleași condiții pe care le va rula în producție.

- Dispunerea proiectului structurat -Folosim șablonul nostru TAPYR open-source pentru aplicații Python strălucitoare. Oferă o structură testată de luptă, care susține în mod natural aceste separații, gestionează configurarea mediului și stabilește logarea. Acest lucru devine crucial atunci când aplicația dvs. de chat crește pentru a include funcții precum istoricul conversației sau procesarea documentelor.

Shiny-gata pentru întreprinderi pentru tablourile de bord Python? Aflați cum Tapyr face construirea și implementarea lor mai ușoară ca niciodată.

Acest lucru ar putea părea excesiv pentru o simplă aplicație de chat. Cu toate acestea, am constatat că proiectele LLM rămân rareori simple. Ceea ce începe pe măsură ce finalizarea textului de bază evoluează adesea în interacțiuni multimodale cu ieșiri structurate. Arhitectura bună face ca aceste tranziții să fie netede fără prea mult.

Tabel care compară funcționalitatea diferitelor moduri de interacțiune cu LLMS în Python

Când menționăm „UX excelent pentru răspunsuri de streaming structurate”, vorbim despre capacitatea de a arăta rezultate parțiale utilizatorilor în timp real, menținând în același timp un format structurat. Cu Langchain, puteți vedea răspunsuri care construiesc jeton după jeton – imaginați -vă că urmăriți o masă populare treptat sau JSON Fields crescând treptat.

În timp ce API -ul de ieșire structurat al OpenAI transmite și răspunsuri, funcționează la nivelul câmpului – veți vedea că câmpurile Pydantic complete apar unul câteodată. Ambele abordări evită să-i facă pe utilizatori să aștepte răspunsul complet, dar streamingul token-by-tok al lui Langchain se simte adesea mai fluid, în special pentru elemente precum blocurile de cod în care a vedea că construcția treptată poate fi mai antrenantă.

Cloud LLMS vin cu compromisuri. Vedeți ce provocări cu care ne -am confruntat și cum le -am abordat în ultimul nostru studiu de caz.

Real-World Integration NotesGetting a început cu LLMS în strălucire pentru Python este simplă. Componenta UI.chat oferă tot ceea ce aveți nevoie pentru funcționalitatea de chat de bază. Dar, la fel ca în majoritatea proiectelor LLM, doriți rapid să o extindeți în moduri neașteptate. O călătorie tipică arată astfel: începeți cu interacțiunile text de bază.

Apoi, doriți răspunsuri structurate să se integreze mai bine cu logica aplicației. Langchain cu Pydantic face acest lucru ușor. Dar pe măsură ce aplicația dvs. crește, este posibil să fie nevoie să gestionați imagini, doar pentru a descoperi că Langchain nu le acceptă încă. Așadar, este posibil să fiți nevoie să treceți la ieșirea structurată nativă a Openai pentru un control mai bun, performanță și set de funcții personalizate. Fiecare pas aduce noi provocări de integrare.

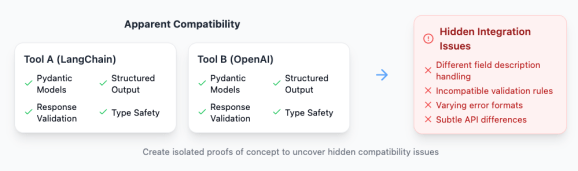

Experiența noastră ne -a învățat când să prototip. Pentru manipularea imaginilor, știam că ar trebui să trecem de la Langchain la apeluri brute OpenAI, astfel încât crearea unui POC a fost o alegere evidentă. Ceea ce ne -a prins de gardă a fost tranziția între implementările de ieșire structurate.

Deoarece atât Langchain, cât și Openai folosesc Pydantic pentru validare, am presupus că comutatorul va fi simplu. În schimb, am descoperit diferențe subtile – cum ar fi sensibilitatea lui Openai la descrierile de câmp în modelele pydantice.

Acest lucru ne -a învățat o lecție valoroasă: creați dovezi izolate ale conceptului chiar și atunci când instrumentele par perfect compatibile.

Cea mai valoroasă lecție? Nu este vorba despre alegerea instrumentelor perfecte în avans. Este vorba despre construirea aplicației dvs., astfel încât să se poată adapta pe măsură ce cerințele evoluează. Indiferent dacă utilizați abstracțiile lui Langchain sau API -urile furnizorului brut, o arhitectură bună face ca aceste tranziții să fie gestionate.

Lecții învățate

Construirea aplicațiilor bazate pe LLM este un proces iterativ.

Iată preluările noastre cheie:

- Creați mici dovezi de concept – Nu doar pentru caracteristici noi, ci și atunci când treceți între instrumente aparent compatibile. Acest obicei economisește un timp semnificativ de refactorizare mai târziu.

- Proiectați -vă codul pentru schimbare. O separare clară între logica LLM și codul aplicației nu este exagerată – este pregătirea pentru o evoluție inevitabilă.

- Când începeți un nou proiect strălucitor pentru Python cu LLMS, luați în considerare utilizarea șablonului nostru TAPYR open-source. Oferă structura necesară pentru întreținere Separarea curată a îngrijorărilor Pe măsură ce aplicația dvs. crește.

Doriți să discutați despre proiectul dvs. strălucitor pentru Python? Ajungeți la Appsilon. Suntem aici pentru a vă ajuta să construiți aplicații robuste și scalabile LLM.

Postarea a apărut mai întâi pe Appsilon.com/blog/.